Мультиколлинеарность

Последствия и признаки мультиколлинеарности

При построении уравнения множественной регрессии может возникнуть проблема мультиколлинеарности факторов. Мультиколлинеарностью называется линейная взаимосвязь двух или нескольких объясняющих переменных, которая может проявляться в функциональной (явной) или стохастической (скрытой) форме.Выявление связи между отобранными признаками и количественная оценка тесноты связи осуществляются с использованием методов корреляционного анализа. Для решения этих задач сначала оценивается матрица парных коэффициентов корреляции, затем на ее основе определяются частные и множественные коэффициенты корреляции и детерминации, проверяется их значимость. Конечной целью корреляционного анализа является отбор факторных признаков x1, x2,…,xm для дальнейшего построения уравнения регрессии.

Если факторные переменные связаны строгой функциональной зависимостью, то говорят о полной мультиколлинеарности. В этом случае среди столбцов матрицы факторных переменных Х имеются линейно зависимые столбцы, и, по свойству определителей матрицы, det(XTX) = 0, т. е. матрица (XTX) вырождена, а значит, не существует обратной матрицы. Матрица (XTX)-1 используется в построении МНК-оценок. Таким образом, полная мультиколлинеарность не позволяет однозначно оценить параметры исходной модели регрессии.

Признаки мультиколлинеарности

- Регрессионные коэффициенты значительно изменяются по мере удаления или добавления новых предикторов;

- Регрессионный коэффициент отрицательный, хотя, исходя из теории, значения зависимой переменной должны расти пропорционально изменению предиктора(или наоборот);

- Ни один из коэффициентов не обладает статистической значимостью, однако F-статистика показывает значимость коэффициента детерминации.

- Регрессионный коэффициент не является значимым, хотя теоретически связь между ним и зависимой переменной должна быть существенной.

- При изменении данных (увеличении или уменьшении выборки) оценки коэффициентов значительно изменяются

К каким трудностям приводит мультиколлинеарность факторов, включенных в модель, и как они могут быть разрешены?

Мультиколлинеарность может привести к нежелательным последствиям:

- оценки параметров становятся ненадежными. Они обнаруживают большие стандартные ошибки. С изменением объема наблюдений оценки меняются (не только по величине, но и по знаку), что делает модель непригодной для анализа и прогнозирования.

- затрудняется интерпретация параметров множественной регрессии как характеристик действия факторов в «чистом» виде, ибо факторы коррелированны; параметры линейной регрессии теряют экономический смысл;

- становится невозможным определить изолированное влияние факторов на результативный показатель.

Вид мультиколлинеарности, при котором факторные переменные связаны некоторой стохастической зависимостью, называется частичной. Если между факторными переменными имеется высокая степень корреляции, то матрица (XTX) близка к вырожденной, т. е. det(XTX) ≈ 0.

Матрица (XTX)-1 будет плохо обусловленной, что приводит к неустойчивости МНК-оценок. Частичная мультиколлинеарность приводит к следующим последствиям:

- увеличение дисперсий оценок параметров расширяет интервальные оценки и ухудшает их точность;

- уменьшение t-статистик коэффициентов приводит к неверным выводам о значимости факторов;

- неустойчивость МНК-оценок и их дисперсий.

Точных количественных критериев для обнаружения частичной мультиколлинеарности не существует. О наличии мультиколлинеарности может свидетельствовать близость к нулю определителя матрицы (XTX). Также исследуют значения парных коэффициентов корреляции. Если же определитель матрицы межфакторной корреляции близок к единице, то мультколлинеарности нет.

Существуют различные подходы преодоления сильной межфакторной корреляции. Простейший из них – исключение из модели фактора (или факторов), в наибольшей степени ответственных за мультиколлинеарность при условии, что качество модели при этом пострадает несущественно (а именно, теоретический коэффициент детерминации -R2y(x1...xm) снизится несущественно).

Перейти к онлайн решению своей задачи

С помощью какой меры невозможно избавиться от мультиколлинеарности?

a) увеличение объема выборки;

b) исключения переменных высококоррелированных с остальными;

c) изменение спецификации модели;

d) преобразование случайной составляющей.

Парные (линейные) и частные коэффициенты корреляции

Тесноту связи, например между переменными x и y по выборке значений (xi, yi), i=1,n, (1)где x и y – средние значения, Sx и Sy – стандартные отклонения соответствующих выборок.

Парный коэффициент корреляции изменяется в пределах от –1 до +1. Чем ближе он по абсолютной величине к единице, тем ближе статистическая зависимость между x и y к линейной функциональной. Положительное значение коэффициента свидетельствует о том, что связь между признаками прямая (с ростом x увеличивается значение y), отрицательное значение – связь обратная (с ростом x значение y уменьшается).

Можно дать следующую качественную интерпретацию возможных значений коэффициента корреляции: если |r|<0.3 – связь практически отсутствует; 0.3≤ |r| < 0.7 - связь средняя; 0.7≤ |r| < 0.9 – связь сильная; 0.9≤ |r| < 0.99 – связь весьма сильная.

Для оценки мультиколлинеарности факторов используют матрицу парных коэффициентов корреляции зависимого (результативного) признака y с факторными признаками x1, x2,…,xm, которая позволяет оценить степень влияния каждого показателя-фактора xj на зависимую переменную y, а также тесноту взаимосвязей факторов между собой. Корреляционная матрица в общем случае имеет вид

.

.

Матрица симметрична, на ее диагонали стоят единицы. Если в матрице есть межфакторный коэффициент корреляции rxjxi>0.7, то в данной модели множественной регрессии существует мультиколлинеарность.

Поскольку исходные данные, по которым устанавливается взаимосвязь признаков, являются выборкой из некой генеральной совокупности, вычисленные по этим данным коэффициенты корреляции будут выборочными, т. е. они лишь оценивают связь. Необходима проверка значимости, которая отвечает на вопрос: случайны или нет полученные результаты расчетов.

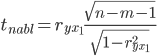

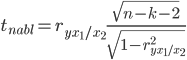

Значимость парных коэффициентов корреляции проверяют по t-критерию Стьюдента. Выдвигается гипотеза о равенстве нулю генерального коэффициента корреляции: H0: ρ = 0. Затем задаются параметры: уровень значимости α и число степеней свободы v = n-2. Используя эти параметры, по таблице критических точек распределения Стьюдента находят tкр, а по имеющимся данным вычисляют наблюдаемое значение критерия:

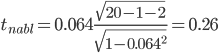

, (2)

, (2)

где r – парный коэффициент корреляции, рассчитанный по отобранным для исследования данным. Парный коэффициент корреляции считается значимым (гипотеза о равенстве коэффициента нулю отвергается) с доверительной вероятностью γ = 1- α, если tНабл по модулю будет больше, чем tкрит.

Если переменные коррелируют друг с другом, то на значении коэффициента корреляции частично сказывается влияние других переменных.

Частный коэффициент корреляции характеризует тесноту линейной зависимости между результатом и соответствующим фактором при устранении влияния других факторов. Частный коэффициент корреляции оценивает тесноту связи между двумя переменными при фиксированном значении остальных факторов. Если вычисляется, например, ryx1|x2 (частный коэффициент корреляции между y и x1 при фиксированном влиянии x2), это означает, что определяется количественная мера линейной зависимости между y и x1, которая будет иметь место, если устранить влияние x2 на эти признаки. Если исключают влияние только одного фактора, получают частный коэффициент корреляции первого порядка.

Сравнение значений парного и частного коэффициентов корреляции показывает направление воздействия фиксируемого фактора. Если частный коэффициент корреляции ryx1|x2 получится меньше, чем соответствующий парный коэффициент ryx1, значит, взаимосвязь признаков y и x1 в некоторой степени обусловлена воздействием на них фиксируемой переменной x2. И наоборот, большее значение частного коэффициента по сравнению с парным свидетельствует о том, что фиксируемая переменная x2 ослабляет своим воздействием связь y и x1.

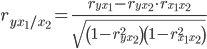

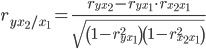

Частный коэффициент корреляции между двумя переменными (y и x2) при исключении влияния одного фактора (x1) можно вычислить по следующей формуле:

. (3)

. (3)

Для других переменных формулы строятся аналогичным образом. При фиксированном x2

;

;

при фиксированном x3

.

.

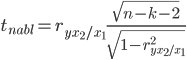

Значимость частных коэффициентов корреляции проверяется аналогично случаю парных коэффициентов корреляции. Единственным отличием является число степеней свободы, которое следует брать равным v = n – l -2, где l – число фиксируемых факторов.

На основании частных коэффициентов можно сделать вывод об обоснованности включения переменных в регрессионную модель. Если значение коэффициента мало или он незначим, то это означает, что связь между данным фактором и результативной переменной либо очень слаба, либо вовсе отсутствует, поэтому фактор можно исключить из модели.

Пошаговая регрессия

Отбор факторов x1, x2, …,xm, включаемых в модель множественной регрессии, является одним из важнейших этапов эконометрического моделирования. Метод последовательного (пошагового) включения (или исключения) факторов в модель позволяет выбрать из возможного набора переменных именно те, которые усилят качество модели.При реализации метода на первом шаге рассчитывается корреляционная матрица. На основе парных коэффициентов корреляции выявляется наличие коллинеарных факторов. Факторы xi и xj признаются коллинеарными, если rxjxi>0.7. В модель включают лишь один из взаимосвязанных факторов. Если среди факторов отсутствуют коллинеарные, то в модель могут быть включены любые факторы, оказывающие существенное влияние на y.

На втором шаге строится уравнение регрессии с одной переменной, имеющей максимальный по абсолютной величине парный коэффициент корреляции с результативным признаком.

На третьем шаге в модель вводится новая переменная, имеющая наибольшее по абсолютной величине значение частного коэффициента корреляции с зависимой переменной при фиксированном влиянии ранее введенной переменной.

При введении в модель дополнительного фактора коэффициент детерминации должен возрастать, а остаточная дисперсия уменьшаться. Если этого не происходит, т. е. коэффициент множественной детерминации увеличивается незначительно, то ввод нового фактора признается нецелесообразным.

Пример №1. По 20 предприятиям региона изучается зависимость выработки продукции на одного работника y (тыс. руб.) от удельного веса рабочих высокой квалификации в общей численности рабочих x1 (% от стоимости фондов на конец года) и от ввода в действие новых основных фондов x2 (%).

| Y | X1 | X2 |

| 6 | 10 | 3,5 |

| 6 | 12 | 3,6 |

| 7 | 15 | 3,9 |

| 7 | 17 | 4,1 |

| 7 | 18 | 4,2 |

| 8 | 19 | 4,5 |

| 8 | 19 | 5,3 |

| 9 | 20 | 5,3 |

| 9 | 20 | 5,6 |

| 10 | 21 | 6 |

| 10 | 21 | 6,3 |

| 11 | 22 | 6,4 |

| 11 | 23 | 7 |

| 12 | 25 | 7,5 |

| 12 | 28 | 7,9 |

| 13 | 30 | 8,2 |

| 13 | 31 | 8,4 |

| 14 | 31 | 8,6 |

| 14 | 35 | 9,5 |

| 15 | 36 | 10 |

Требуется:

- Построить корреляционное поле между выработкой продукции на одного работника и удельным весом рабочих высокой квалификации. Выдвинуть гипотезу о тесноте и виде зависимости между показателями X1 и Y .

- Оценить тесноту линейной связи между выработкой продукции на одного работника и удельным весом рабочих высокой квалификации с надежностью 0,9.

- Рассчитать коэффициенты линейного уравнения регрессии для зависимости выработки продукции на одного работника от удельного веса рабочих высокой квалификации.

- Проверить статистическую значимость параметров уравнения регрессии с надежностью 0,9 и построить для них доверительные интервалы.

- Рассчитать коэффициент детерминации. С помощью F -критерия Фишера оценить статистическую значимость уравнения регрессии с надежностью 0,9.

- Дать точечный и интервальный прогноз с надежностью 0,9 выработки продукции на одного работника для предприятия, на котором высокую квалификацию имеют 24% рабочих.

- Рассчитать коэффициенты линейного уравнения множественной регрессии и пояснить экономический смысл его параметров.

- Проанализировать статистическую значимость коэффициентов множественного уравнения с надежностью 0,9 и построить для них доверительные интервалы.

- Найти коэффициенты парной и частной корреляции. Проанализировать их.

- Найти скорректированный коэффициент множественной детерминации. Сравнить его с нескорректированным (общим) коэффициентом детерминации.

- С помощью F -критерия Фишера оценить адекватность уравнения регрессии с надежностью 0,9.

- Дать точечный и интервальный прогноз с надежностью 0,9 выработки продукции на одного работника для предприятия, на котором высокую квалификацию имеют 24% рабочих, а ввод в действие новых основных фондов составляет 5%.

- Проверить построенное уравнение на наличие мультиколлинеарности по: критерию Стьюдента; критерию χ2. Сравнить полученные результаты.

Решение проводим с помощью калькулятора. Далее приводится ход решения п.13.

Матрица парных коэффициентов корреляции R:

| - | y | x1 | x2 |

| y | 1 | 0.97 | 0.991 |

| x1 | 0.97 | 1 | 0.977 |

| x2 | 0.991 | 0.977 | 1 |

При наличии мультиколлинеарности определитель корреляционной матрицы близок к нулю. Для нашего примера:

det = 0.00081158, что свидетельствует о наличии сильной мультиколлинеарности.

Для отбора наиболее значимых факторов xi учитываются следующие условия:

- связь между результативным признаком и факторным должна быть выше межфакторной связи;

- связь между факторами должна быть не более 0.7. Если в матрице есть межфакторный коэффициент корреляции rxjxi > 0.7, то в данной модели множественной регрессии существует мультиколлинеарность.;

- при высокой межфакторной связи признака отбираются факторы с меньшим коэффициентом корреляции между ними.

В нашем случае rx1 x2 имеют |r|>0.7, что говорит о мультиколлинеарности факторов и о необходимости исключения одного из них из дальнейшего анализа.

Анализ первой строки этой матрицы позволяет произвести отбор факторных признаков, которые могут быть включены в модель множественной корреляционной зависимости. Факторные признаки, у которых |ryxi| < 0.5 исключают из модели. Можно дать следующую качественную интерпретацию возможных значений коэффициента корреляции (по шкале Чеддока): если |r|>0.3 – связь практически отсутствует; 0.3 ≤ |r| ≤ 0.7 - связь средняя; 0.7 ≤ |r| ≤ 0.9 – связь сильная; |r| > 0.9 – связь весьма сильная.

Проверим значимость полученных парных коэффициентов корреляции с помощью t-критерия Стьюдента. Коэффициенты, для которых значения t-статистики по модулю больше найденного критического значения, считаются значимыми.

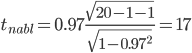

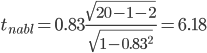

Рассчитаем наблюдаемые значения t-статистики для ryx1 по формуле:

где m = 1 - количество факторов в уравнении регрессии.

По таблице Стьюдента находим Tтабл

tкрит(n-m-1;α/2) = (18;0.025) = 2.101

Поскольку tнабл > tкрит, то отклоняем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически - значим

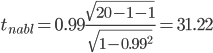

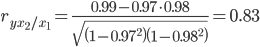

Рассчитаем наблюдаемые значения t-статистики для ryx2 по формуле:

Поскольку tнабл > tкрит, то отклоняем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически - значимю

Таким образом, связь между (y и xx1 ), (y и xx2 ) является существенной.

Наибольшее влияние на результативный признак оказывает фактор x2 (r = 0.99), значит, при построении модели он войдет в регрессионное уравнение первым.

Тестирование и устранение мультиколлинеарности.

Наиболее полным алгоритмом исследования мультиколлинеарности является алгоритм Фаррара-Глобера. С его помощью тестируют три вида мультиколлинеарности:

1. Всех факторов (χ2 - хи-квадрат).

2. Каждого фактора с остальными (критерий Фишера).

3. Каждой пары факторов (критерий Стьюдента).

Проверим переменные на мультиколлинеарность методом Фаррара-Глоубера по первому виду статистических критериев (критерий "хи-квадрат").

Формула для расчета значения статистики Фаррара-Глоубера:

χ2 = -[n-1-(2m+5)/6]ln(det[R])

где m = 2 - количество факторов, n = 20 - количество наблюдений, det[R] - определитель матрицы парных коэффициентов корреляции R.

Сравниваем его с табличным значением при v = m/2(m-1) = 1 степенях свободы и уровне значимости α. Если χ2 > χтабл2, то в векторе факторов есть присутствует мультиколлинеарность.

χтабл2(1;0.05) = 3.84146

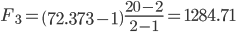

Проверим переменные на мультиколлинеарность по второму виду статистических критериев (критерий Фишера).

Определяем обратную матрицу D = R-1:

| D = |

|

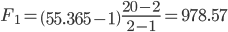

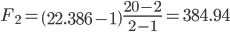

Вычисляем F-критерии Фишера:

где dkk - диагональные элементы матрицы.

Рассчитанные значения критериев сравниваются с табличными при v1=n-m и v2=m-1 степенях свободы и уровне значимости α. Если Fk > FТабл, то k-я переменная мультиколлинеарна с другими.

v1=20-2 = 18; v2=2-1 = 1. FТабл(18;1) = 248

Поскольку F1 > Fтабл, то переменная y мультиколлинеарна с другими.

Поскольку F2 > Fтабл, то переменная x1 мультиколлинеарна с другими.

Поскольку F3 > Fтабл, то переменная x2 мультиколлинеарна с другими.

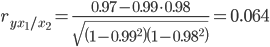

Проверим переменные на мультиколлинеарность по третьему виду статистических критериев (критерий Стьюдента). Для этого найдем частные коэффициенты корреляции.

Частные коэффициенты корреляции.

Коэффициент частной корреляции отличается от простого коэффициента линейной парной корреляции тем, что он измеряет парную корреляцию соответствующих признаков (y и xi) при условии, что влияние на них остальных факторов (xj) устранено.

На основании частных коэффициентов можно сделать вывод об обоснованности включения переменных в регрессионную модель. Если значение коэффициента мало или он незначим, то это означает, что связь между данным фактором и результативной переменной либо очень слаба, либо вовсе отсутствует, поэтому фактор можно исключить из модели.

Теснота связи низкая.

Определим значимость коэффициента корреляции ryx1 /x2 .

Для этого рассчитаем наблюдаемые значения t-статистики по формуле:

где k = 1 - число фиксируемых факторов.

По таблице Стьюдента находим Tтабл

tкрит(n-k-2;α/2) = (17;0.025) = 2.11

Поскольку tнабл < tкрит, то принимаем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически - не значим

Как видим, связь y и x1 при условии, что x2 войдет в модель, снизилась. Отсюда можно сделать вывод, что ввод в регрессионное уравнение x1 остается нецелесообразным.

Теснота связи сильная

Определим значимость коэффициента корреляции ryx2 /x1 .

Для этого рассчитаем наблюдаемые значения t-статистики по формуле:

Поскольку tнабл > tкрит, то отклоняем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически - значим

Как видим, связь y и x2 при условии, что x1 войдет в модель, снизилась. Отсюда можно сделать вывод, что ввод в регрессионное уравнение x2 остается нецелесообразным.

Можно сделать вывод, что при построении регрессионного уравнения следует отобрать факторы x1 , x2.

Пример №2. По 30 наблюдениям матрица парных коэффициентов корреляции оказалась следующей:

| y | x1 | x2 | x3 | |

| y | 1,0 | |||

| x1 | 0,30 | 1,0 | ||

| x2 | 0,60 | 0,10 | 1,0 | |

| x3 | 0,40 | 0,15 | 0,80 | 1,0 |