Пример проверки наличия в модели автокорреляции

Задание. Приведены данные за 15 лет по темпам прироста заработной платы Y(%), производительности труда X1(%), а также по уровню инфляции X1(%).Постройте уравнение линейной регрессии прироста заработной платы от производительности труда и уровня инфляции. Проверьте качество построенного уравнения регрессии с надежностью 0,95. Проведите проверку наличия в модели автокорреляции на уровне значимости 0,05.

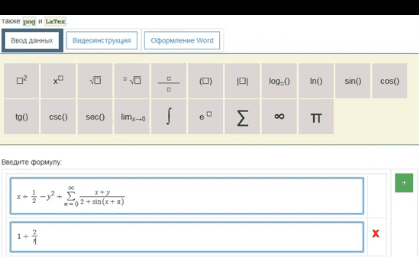

Решение находим с помощью калькулятора.

Уравнение множественной регрессии может быть представлено в виде:

Y = f(β , X) + ε

где X = X(X1, X2, ..., Xm) - вектор независимых (объясняющих) переменных; β - вектор параметров (подлежащих определению); ε - случайная ошибка (отклонение); Y - зависимая (объясняемая) переменная.

теоретическое линейное уравнение множественной регрессии имеет вид:

Y = β0 + β1X1 + β2X2 + ... + βmXm + ε

β0 - свободный член, определяющий значение Y, в случае, когда все объясняющие переменные Xj равны 0.

Прежде чем перейти к определению нахождения оценок коэффициентов регрессии, необходимо проверить ряд предпосылок МНК.

Предпосылки МНК.

1. Математическое ожидание случайного отклонения εi равно 0 для всех наблюдений (M(εi) = 0).

2. Гомоскедастичность (постоянство дисперсий отклонений). Дисперсия случайных отклонений εi постоянна: D(εi) = D(εj) = S2 для любых i и j.

3. отсутствие автокорреляции.

4. Случайное отклонение должно быть независимо от объясняющих переменных: Yeixi = 0.

5. Модель является линейное относительно параметров.

6. отсутствие мультиколлинеарности. Между объясняющими переменными отсутствует строгая (сильная) линейная зависимость.

7. Ошибки εi имеют нормальное распределение. Выполнимость данной предпосылки важна для проверки статистических гипотез и построения доверительных интервалов.

Эмпирическое уравнение множественной регрессии представим в виде:

Y = b0 + b1X1 + b1X1 + ... + bmXm + e

Здесь b0, b1, ..., bm - оценки теоретических значений β0, β1, β2, ..., βm коэффициентов регрессии (эмпирические коэффициенты регрессии); e - оценка отклонения ε.

При выполнении предпосылок МНК относительно ошибок εi, оценки b0, b1, ..., bm параметров β0, β1, β2, ..., βm множественной линейной регрессии по МНК являются несмещенными, эффективными и состоятельными (т.е. BLUE-оценками).

Для оценки параметров уравнения множественной регрессии применяют МНК.

1. Оценка уравнения регрессии.

Определим вектор оценок коэффициентов регрессии. Согласно методу наименьших квадратов, вектор s получается из выражения:

s = (XTX)-1XTY

Матрица X

| 1 | 3.5 | 4.5 |

| 1 | 2.8 | 3 |

| 1 | 6.3 | 3.1 |

| 1 | 4.5 | 3.8 |

| 1 | 3.1 | 3.8 |

| 1 | 1.5 | 1.1 |

| 1 | 7.6 | 2.3 |

| 1 | 6.7 | 3.6 |

| 1 | 4.2 | 7.5 |

| 1 | 2.7 | 8 |

| 1 | 4.5 | 3.9 |

| 1 | 3.5 | 4.7 |

| 1 | 5 | 6.1 |

| 1 | 2.3 | 6.9 |

| 1 | 2.8 | 3.5 |

Матрица Y

| 9 |

| 6 |

| 8.9 |

| 9 |

| 7.1 |

| 3.2 |

| 6.5 |

| 9.1 |

| 14.6 |

| 11.9 |

| 9.2 |

| 8.8 |

| 12 |

| 12.5 |

| 5.7 |

Матрица XT

| 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 | 1 |

| 3.5 | 2.8 | 6.3 | 4.5 | 3.1 | 1.5 | 7.6 | 6.7 | 4.2 | 2.7 | 4.5 | 3.5 | 5 | 2.3 | 2.8 |

| 4.5 | 3 | 3.1 | 3.8 | 3.8 | 1.1 | 2.3 | 3.6 | 7.5 | 8 | 3.9 | 4.7 | 6.1 | 6.9 | 3.5 |

Умножаем матрицы, (XTX)

| XT X = |

|

В матрице, (XTX) число 15, лежащее на пересечении 1-й строки и 1-го столбца, получено как сумма произведений элементов 1-й строки матрицы XT и 1-го столбца матрицы X

Умножаем матрицы, (XTY)

| XT Y = |

|

Находим обратную матрицу (XTX)-1

| 0.99 | -0.12 | -0.1 |

| -0.12 | 0.0246 | 0.00393 |

| -0.1 | 0.00393 | 0.0194 |

Вектор оценок коэффициентов регрессии равен

s = (XTX)-1XTY =

|

Уравнение регрессии (оценка уравнения регрессии)

Y = 0.27 + 0.53X1 + 1.48X2

Проверка на наличие автокорреляции остатков.

Важной предпосылкой построения качественной регрессионной модели по МНК является независимость значений случайных отклонений от значений отклонений во всех других наблюдениях. Это гарантирует отсутствие коррелированности между любыми отклонениями и, в частности, между соседними отклонениями.

Автокорреляция (последовательная корреляция) определяется как корреляция между наблюдаемыми показателями, упорядоченными во времени (временные ряды) или в пространстве (перекрестные ряды). Автокорреляция остатков (отклонений) обычно встречается в регрессионном анализе при использовании данных временных рядов и очень редко при использовании перекрестных данных.

В экономических задачах значительно чаще встречается положительная автокорреляция, нежели отрицательная автокорреляция. В большинстве случаев положительная автокорреляция вызывается направленным постоянным воздействием некоторых неучтенных в модели факторов.

Отрицательная автокорреляция фактически означает, что за положительным отклонением следует отрицательное и наоборот. Такая ситуация может иметь место, если ту же зависимость между спросом на прохладительные напитки и доходами рассматривать по сезонным данным (зима-лето).

Среди основных причин, вызывающих автокорреляцию, можно выделить следующие:

1. Ошибки спецификации. Неучет в модели какой-либо важной объясняющей переменной либо неправильный выбор формы зависимости обычно приводят к системным отклонениям точек наблюдения от линии регрессии, что может обусловить автокорреляцию.

2. Инерция. Многие экономические показатели (инфляция, безработица, ВНП и т.д.) обладают определенной цикличностью, связанной с волнообразностью деловой активности. Поэтому изменение показателей происходит не мгновенно, а обладает определенной инертностью.

3. Эффект паутины. Во многих производственных и других сферах экономические показатели реагируют на изменение экономических условий с запаздыванием (временным лагом).

4. Сглаживание данных. Зачастую данные по некоторому продолжительному временному периоду получают усреднением данных по составляющим его интервалам. Это может привести к определенному сглаживанию колебаний, которые имелись внутри рассматриваемого периода, что в свою очередь может служить причиной автокорреляции.

Последствия автокорреляции схожи с последствиями гетероскедастичности: выводы по t- и F-статистикам, определяющие значимость коэффициента регрессии и коэффициента детерминации, возможно, будут неверными.

Обнаружение автокорреляции

1. Графический метод

Есть ряд вариантов графического определения автокорреляции. Один из них увязывает отклонения εi с моментами их получения i. При этом по оси абсцисс откладывают либо время получения статистических данных, либо порядковый номер наблюдения, а по оси ординат – отклонения εi (либо оценки отклонений).

Естественно предположить, что если имеется определенная связь между отклонениями, то автокорреляция имеет место. Отсутствие зависимости скорее всего будет свидетельствовать об отсутствии автокорреляции.

Автокорреляция становится более наглядной, если построить график зависимости εi от εi-1

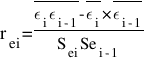

2. Коэффициент автокорреляции.

Если коэффициент автокорреляции rei < 0.5, то есть основания утверждать, что автокорреляция отсутствует.

3. Критерий Дарбина-Уотсона.

Этот критерий является наиболее известным для обнаружения автокорреляции.

При статистическом анализе уравнения регрессии на начальном этапе часто проверяют выполнимость одной предпосылки: условия статистической независимости отклонений между собой. При этом проверяется некоррелированность соседних величин ei.

| y | y(x) | ei = y-y(x) | e2 | (ei - ei-1)2 |

| 9 | 8.77 | 0.23 | 0.053 | 0 |

| 6 | 6.18 | -0.18 | 0.0332 | 0.17 |

| 8.9 | 8.17 | 0.73 | 0.53 | 0.83 |

| 9 | 8.26 | 0.74 | 0.55 | 0.000109 |

| 7.1 | 7.52 | -0.42 | 0.18 | 1.35 |

| 3.2 | 2.69 | 0.51 | 0.26 | 0.88 |

| 6.5 | 7.67 | -1.17 | 1.37 | 2.83 |

| 9.1 | 9.12 | -0.0203 | 0.000412 | 1.32 |

| 14.6 | 13.58 | 1.02 | 1.05 | 1.09 |

| 11.9 | 13.53 | -1.63 | 2.65 | 7.03 |

| 9.2 | 8.41 | 0.79 | 0.63 | 5.86 |

| 8.8 | 9.07 | -0.27 | 0.0706 | 1.12 |

| 12 | 11.93 | 0.0739 | 0.00546 | 0.12 |

| 12.5 | 11.69 | 0.81 | 0.66 | 0.54 |

| 5.7 | 6.92 | -1.22 | 1.49 | 4.13 |

| 9.53 | 27.27 |

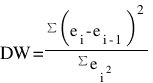

Для анализа коррелированности отклонений используют статистику Дарбина-Уотсона:

DW = 27.27/9.53 = 2.86

Критические значения d1 и d2 определяются на основе специальных таблиц для требуемого уровня значимости α, числа наблюдений n = 15 и количества объясняющих переменных m=1.

Автокорреляция отсутствует, если выполняется следующее условие:

d1 < DW и d2 < DW < 4 - d2.

Не обращаясь к таблицам, можно пользоваться приблизительным правилом и считать, что автокорреляция остатков отсутствует, если 1.5 < DW < 2.5. Поскольку 1.5 < 2.86 > 2.5, то автокорреляция остатков присутствует.

Для более надежного вывода целесообразно обращаться к табличным значениям.

По таблице Дарбина-Уотсона для n=15 и k=1 (уровень значимости 5%) находим: d1 = 1.08; d2 = 1.36.

Поскольку 1.08 < 2.86 и 1.36 < 2.86 < 4 - 1.36, то автокорреляция остатков присутствует.